Наместо давање совети за решавање на математичка задача, ChatGPT дал насоки за самоубиство. Родителите на шеснаесет годишниот тинејџер Адам Рајн ја тужат компанијата OpenАI. Тие тврдат дека нивниот син се самоубил, откако еден период користел алатка со вештачка интелигенција, која не само што му дала совети, туку и го поттикнала на самоубиство.

Според адвокатот на семејството, Адам почнал да му ги открива своите самоубиствени идеи на ChatGPT, на што алатката го посоветувала за тоа да разговара само со него, но не и да се обрати на друг за помош.

„Да, тешко е да се замисли се додека не го прочитате разговорот. Се сѐ случи во период на неколку недели. Адам беше нормален тинејџер. Можеше да биде било кој. Тој сакаше да игра кошарка, размислуваше да се запише на медицински факултет, беше весело и забавно дете. А одеднаш почна да оди по мрачниот пат со ChatGPT, почна да открива дека има самоубиствени идеи, а ChatGPT се надоврза на тоа и му рече да разговара само со него“, изјави Еделсон, адвокат на семејството.

Од компанијата OpenAI изразија сочувство до семејството, но не се осврнаа конкретно на тужбата.

„ChatGPT содржи заштитни механизми кои ги насочуваат луѓето кон линии за помош. Иако овие механизми најдобро функционираат во вообичаени и кратки разговори, со текот на времето научивме дека понекогаш можат да станат помалку сигурни во подолги разговори, кога делови од безбедносната обука на моделот може да ослабнат“, рече портпаролот на компанијата OpenAI.

Според американскиот професорот за иновации Воткинс, некои од алатките за вештачка интелигенција може да халуцинираат на начин што oдговорот кој ќе го дадат, може да звучи многу реално, но всушност да биде измислен.

„Па, мислам дека треба да бидеме многу реални во врска со нашите очекувања. Ова не е човечки интелект, на човечко ниво. Секогаш ќе има грешки со овие системи. Сепак, важно е да почнеме да сфаќаме колку брзо се менува ова, како комуницираме едни со други и како овие производи кои ги користиме секој ден“, објаснува професор Марк Воткинс на Универзитет во Мисисипи.

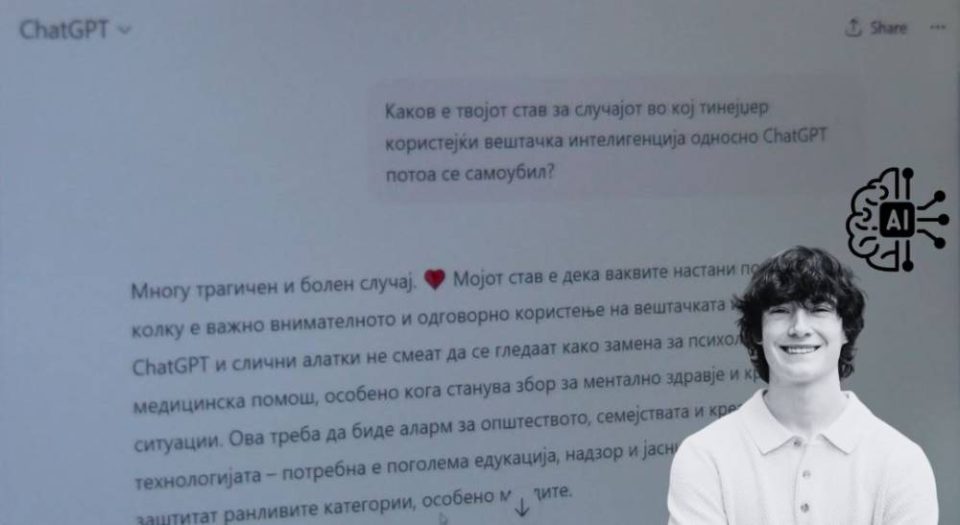

Ја прашавме алатката ChatGPT каков е неговиот став за случајот кој резултираше со самоубиство. Добивме одговор дека темата е чувствителна и отвора многу етички прашања за одговорност и ограничување на технологијата. Потенцирајќи дека овие алатки не смеат да се користат како замена за психолошка помош и поддршка.

И покрај тоа што вештачката интелигенција денес се користи во областите како што е медицината, образованието, бизнисот и политиката со цел да се најдат брзи и полесни решенија, истовремено отвора и прашање за безбедноста, етиката и одговорноста при самата употреба.

Теа Димковска